В январе в России и мире появилась новая волна дипфейков, сгенерированных на основе сделанных в 2016 году фотографий и видео, массово выкладываемых в соцсетях. Для изготовления правдоподобных подделок мошенники собирают хранящиеся в открытом доступе материалы с помощью специальных программ.

По словам экспертов, на таких архивных снимках нет цифровых следов, по которым обычно можно распознать фальсификацию, поэтому они особенно удобны для злоумышленников. В результате создаются дипфейки откровенного содержания. Специалисты предупреждают, что число подобных подделок может резко вырасти в ближайшее время. Десять лет назад технологии ИИ еще не применялись, поэтому старые фото и видео считаются «чистыми» и идеально подходят для создания фальсификаций.

Как обманывают пользователей мессенджеров

Волна публикаций в соцсетях с фотографиями и видео, сделанными в 2016 году, привела к появлению новой разновидности дипфейков, рассказали «Известиям» эксперты по кибербезопасности. Мошенники используют архивные изображения, чтобы создавать поддельные компрометирующие ролики — так называемые дипфейки из прошлого. Если раньше исходные материалы нужно было специально искать, то теперь пользователи сами выкладывают их в открытый доступ.

— Парсинговым системам (автоматизированным программам сбора данных с сайтов) достаточно извлечь изображения со страниц в соцсетях, чтобы получить материал для подделок, — пояснил руководитель исследовательских проектов VisionLabs Александр Паркин.

По словам основателя компании «Интернет-Розыск» Игоря Бедерова, проблема дипфейков уже стала массовой. Каждый десятый россиянин сталкивался с попытками мошенничества с их использованием, а общий ущерб от киберпреступлений за первые семь месяцев 2025 года достиг 119 млрд рублей, что на 16% больше, чем годом ранее.

— Доступ к архивным фотографиям может привести к резкому росту таких атак, — отметил Игорь Бедеров.

По его оценке, в ближайшие месяцы число преступлений с использованием дипфейков может увеличиться в 5–10 раз, доля случаев с прямым финансовым ущербом тоже вырастет.

Эксперт по информационной безопасности компании «Киберпротект» Саркис Шмавонян подтвердил этот прогноз, отметив, что точной статистики по дипфейкам нет, поскольку о многих случаях не сообщается в правоохранительные органы.

— Инструменты для создания дипфейков стали доступными, а «сырье» для них — массовым, поэтому резкий рост таких преступлений выглядит вполне реалистичным, — подчеркнул специалист.

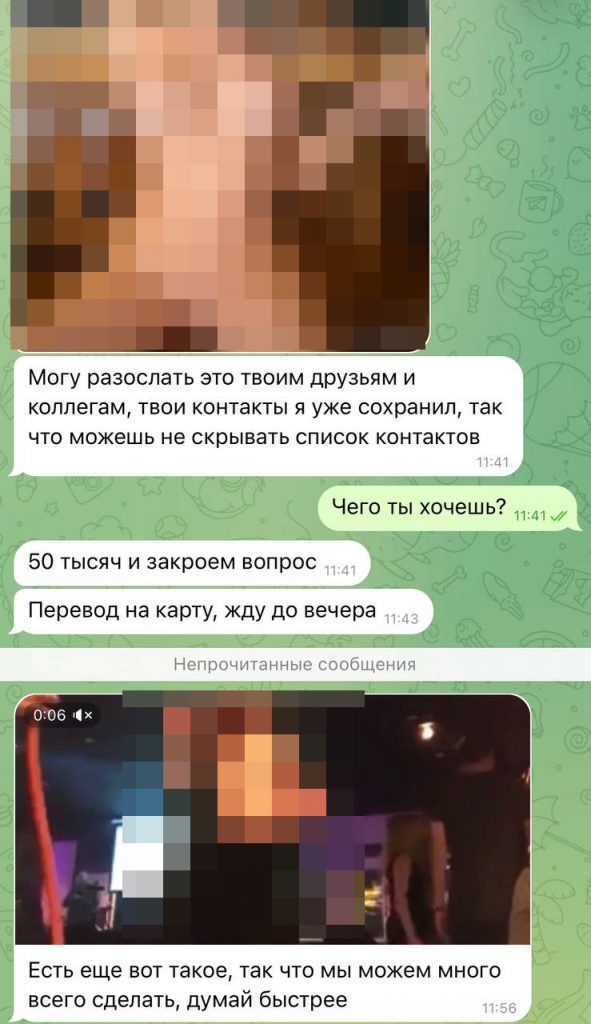

«Известия» ознакомились с жалобами пользователей, поступившими на горячую линию в Региональный общественный центр интернет-технологий (РОЦИТ). В январе 2026 года люди сообщали о дипфейках в Telegram и каналах, распространяющих порочащую информацию. Одна из пострадавших, Анна из Нижнего Новгорода, поделилась, что получила видео интимного содержания с ее участием и угрозы распространить их дальше. По ее словам, на записях она выглядела значительно моложе своего возраста.

— Я просто заблокировала отправителя, пожаловалась на контент и ограничила контакты с незнакомыми людьми. После этого новых попыток шантажа не было, — рассказала она.

С юридической точки зрения действия мошенников подпадают под статьи Уголовного кодекса, пояснил юрист Игорь Долгополов. В первую очередь, речь идет о ст. 159 УК РФ («Мошенничество»), а также, в зависимости от ситуации, о нарушении неприкосновенности частной жизни.

— Отдельной классификации дипфейков на «старые» и «новые» в законодательстве не существует, — уточнил он.

Где находят потенциальных жертв

Этот вид мошенничества сейчас находится на этапе сбора данных, поэтому большинство случаев пока не выделяют в отдельную категорию и учитывают в общей статистике преступлений с использованием ИИ. Сейчас могут реализовываться тысячи атак, но реальный масштаб проблемы станет заметен в ближайшие месяцы, когда накопленные архивы начнут массово использоваться для персонализированного шантажа и обмана, пояснила интернет-аналитик компании «Газинформсервис» Марина Пробетс.

— Флешмоб «2016», который сейчас активно распространяется в соцсетях, может использоваться злоумышленниками для совмещения старых и актуальных изображений. Это помогает уточнять черты лица и улучшать качество подделок. Опасность заключается не столько в самом флешмобе, сколько в быстром развитии ИИ, которое упрощает создание убедительных фальшивок, — рассказал руководитель направления отдела анализа и оценки цифровых угроз Infosecurity (ГК Softline) Максим Грязев.

В ближайшие годы количество дипфейков будет расти кратно — до пяти раз в год, считают в MWS AI. В компании отмечают, что в России уже зафиксировано множество случаев создания дипфейков откровенного содержания, когда на реальные видео накладывают изображение лица человека, взятое с фотографии.

По словам руководителя IT-подразделения агентства «Полилог» Людмилы Богатыревой, сервисы для создания подобных эффектов уже широко доступны, в том числе прямо в социальных сетях.

— Люди всё меньше доверяют видеоконтенту, понимая, что его легко подделать, — отметила она.

Старые фотографии и видео могут использоваться для создания вымышленного компрометирующего прошлого: от фальшивых личных историй до дискредитирующих заявлений о взглядах человека, считает начальник отдела безопасности «СерчИнформ» Алексей Дрозд.

В то же время не все эксперты считают флешмобы ключевой угрозой. По словам руководителя направления исследований данных в «Лаборатории Касперского» Дмитрия Аникина, риски использования подобных изображений для обучения нейросетей существуют, но они не критичны.

— Современные алгоритмы умеют достаточно точно определять возраст по изображениям, и для этого им не нужны массовые публикации старых фото, — уточнил эксперт.

Эксперты сходятся в одном: пользователям важно сохранять цифровую осторожность и внимательно относиться к тому, какой контент они делают публичным. Любые данные, однажды размещенные в Сети, могут быть использованы повторно — и не всегда в ожидаемом контексте.

ИЗВЕСТИЯ, РОССИЯ