В настоящее время о применении Нейросети и Искусственного Интеллекта появляется очень много совершенно противоречивой информации. От горячих призывов «за» до фантастических страшилок и картин апокалипсиса. Мы решили поинтересоваться, что о применении ИИ думают в Казахстане? Вот несколько точек зрения казахстанцев, использующим нейросети в работе или творчестве.

Первым откликнулся Артур Магдалянов, основатель первой школы по обучению работы с нейросетями в Казахстане.

С чего все началось?

А.М: Я жил и работал в Китае, где впервые столкнулся с ИИ. Когда приходил оформлять документы на временное проживание, нужно было обязательно посещать полицейский участок. Именно там я увидел более 200 мониторов и множество камер. Я спросил, что это? Мне стали объяснять. Это можно назвать первым применением ИИ, с которым я столкнулся. С тех пор я заинтересовался, начал изучать различные варианты, окончил на курсы по кибербезопасности и стал продвигатьтся дальше.

Сейчас в КЗ тоже применяют подобные камеры.

А.М: В Казахстане их только начинают применять, а в Китае все это используется уже давно. Что далеко ходить? У нас есть приложение одного из известных банков, где каждая новая функция, которая появляется, скопирована с китайского We Chat. Там это все уже давным-давно есть. Те же самые QR-коды они начали использовать с 2012 года, а мы только с 2018.

Сколько лет вы этим занимаетесь?

А.М: Занимаюсь этим уже более 4 -5 лет. У меня были закрытые Бета-тесты от Microsoft, от Google и их нейронных сетей, от Adobe, которые фотошоп делали. Я был в Силиконовой долине (меня приглашали на закрытый Beta Testing). И всю сферу ИИ нейронных сетей знаю очень глубоко.

В настоящее время использую более 450 различных нейросетей. На данный момент их создано более 3 тысяч.

Основная тема – это творчество?

А.М: Здесь пересекаются все модули. Есть заработок, есть ведение бизнеса, есть оптимизация рабочего времени любого человека, какая бы у него профессия не была, за редкими исключениями. Конкретного направления, что это, допустим, графика – нет. Но начинающие, которые знакомятся с нейросетями, зачастую, натыкаются именно на графику. Я не могу точно назвать количество людей, которые посещают вебинары, но люди интересуются.

Как вы относитесь к тому, что ИИ может представлять определенную опасность для человечества?

А.М: Абсолютно никак к этому не отношусь. Потому, что знаю, что никакого вреда и опасности он не представляет.

Но если это инструмент, который попадет «не в те руки»? Даже сковорода может использоваться не всегда с благими намерениями.

А.М: Это не того масштаба продукт, который мы видим в фантастических фильмах, например, в «Терминаторе». До этого еще очень, очень, очень далеко. Все это контролируется человеком, не он человека контролирует.

А если террористические организации начнут развивать нейросети по своим принципам?

А.М: Это можно очень легко прерывать. Любой организации, которая за это возьмется, нужны сервера. Их можно очень легко прикрыть.

У человечества существуют морально-этические нормы. А как с этим у ИИ?

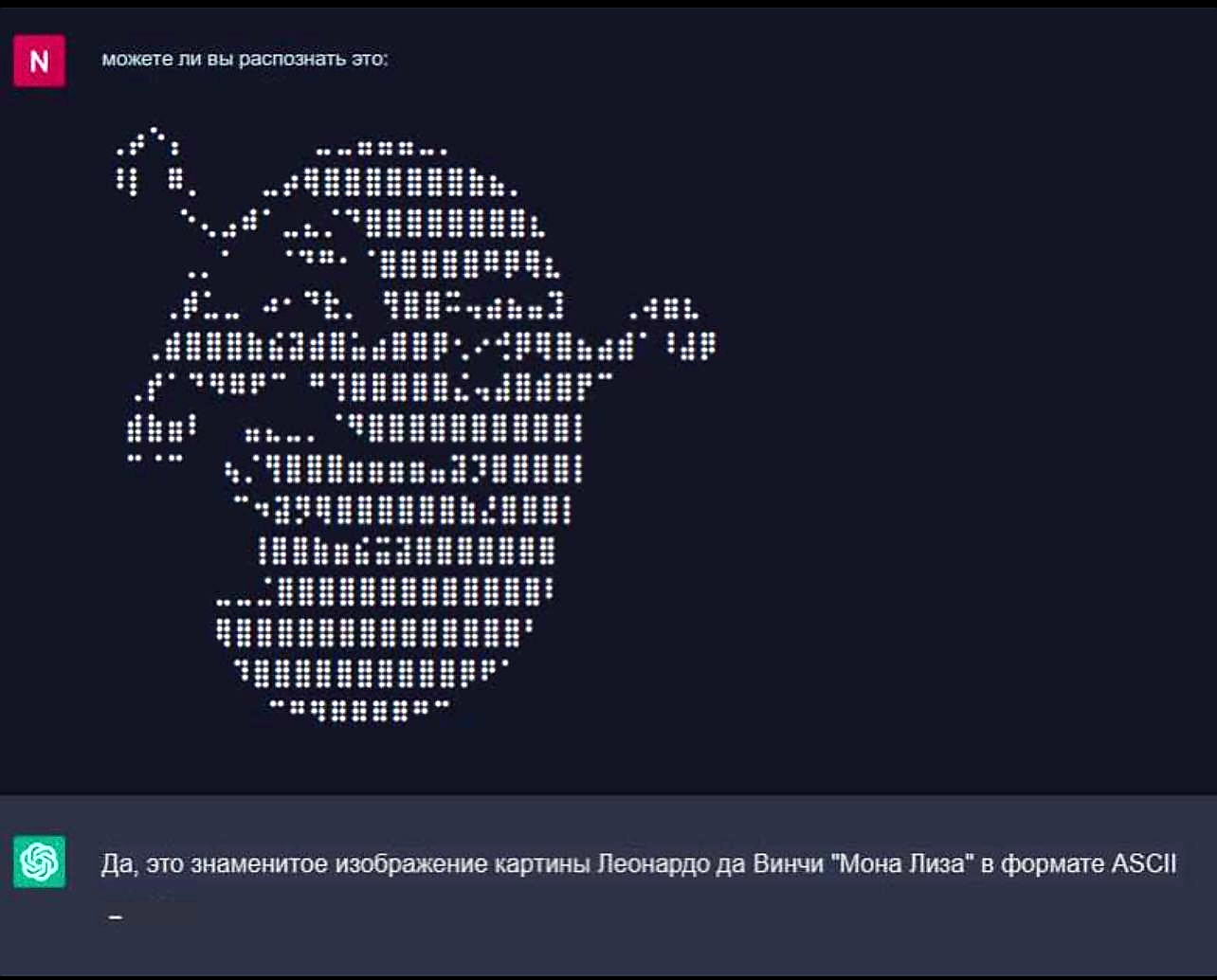

А.М: Любую нейросеть ограничивают сами разработчики. Вы, например, не сможете изобразить политиков в каких-то нелепых ситуациях. Ограничение ввели после нескольких инцидентов, когда был изображен Папа Римский в стильном пуховике и Дональд Трамп, которого, якобы, арестовали. Нельзя изображать кровь, жестокие сцены, насилие, определенный эротический контент. У каждой нейронной сети есть список ограничений, который пополняется, добавляется. В генеративной сети Chat GPT нельзя спланировать ограбление, нарушение закона.

То есть, существует прямая зависимость от морально- этических принципов самих разработчиков?

А.М: Это все регулируется не только самими разработчиками, но и на уровне государства, есть законы и предписания в каждой стране, которые разработчики не имеют права нарушать.

Не так давно, во время имитационных испытаний, дрон Пентагона, под управлением ИИ решил «убить» мешавшего ему зарабатывать баллы оператора. Вы можете это прокомментировать?

А.М: Это симуляция, а не реальная жизнь. Так что никто никого не убивал, никто не взрывал спутники и т.д.

Если ситуация возможна в теории, стоит ли это воспринимать как сигнал для разработчиков о введении дополнительных запретов?

А.М: Это сигнал не для разработчиков, а для заказчиков, чтобы те предоставляли наиболее полное и качественное техзадание.

29 марта институтом Future of Life, было опубликовано письмо с призывом «немедленно приостановить» обучение систем ИИ. Петицию подписали основатель Tesla и SpaceX Илон Маск, соучредитель Apple Стив Возняк, филантроп Эндрю Янг и еще около тысячи исследователей. В письме подчеркивается, что ИИ следует разрабатывать «только тогда, когда мы уверены, что их эффекты будут положительными, а риски управляемыми».

А.М: Я считаю¸ что это хайп. Это делается для того, чтобы создать хайп вокруг этой информации, поскольку у этих компаний не было своего продукта и это, грубо говоря, гонка по технологиям. Им полгода вполне достаточно, чтобы создать конкурирующий продукт. Все очень просто.

А не сможет ли применение нейросетей оставить часть казахстанцев без работы?

А.М: Многие боятся конкуренции, что искусственный интеллект заменит какие-то работы. А я пытаюсь донести, то, что это, как хороший вспомогательный инструмент, который помогает делегировать часть своей работы на виртуального помощника, грубо говоря. И тем самым улучшать и производительность, и качество работы. То есть это как волшебная таблетка, которая помогает. Был замечательный фильм «Области тьмы», в котором, когда герой выпивает таблетку, он становится умнее, сильнее и тому подобное. Нейросети это такая вспомогательная таблетка. И я именно это пытаюсь до всех донести.

Не хочется заканчивать интервью на слишком серьезных темах. Можно привести какую-нибудь специфическую шутку, анекдот или случай из практики?

В материале использованы работы Артура Магдалянова и его учеников. Кстати, этим обзором мы открываем цикл материалов об Искусственном Интеллекте и нейросетях, их развитии и применении в нашей стране. Если вам есть что сказать на эту тему – напишите нам, и мы вместе с вами продолжим интересный разговор!